こういう個人の技術記事、読み進めてったら「ほしい情報がねえじゃねーか!」というのが私は苦痛になるので先に何やったか書きます

参考にしたページ:リンク

参考にしたページの応用編の最初で力尽きました

参考にしたページを観よう!

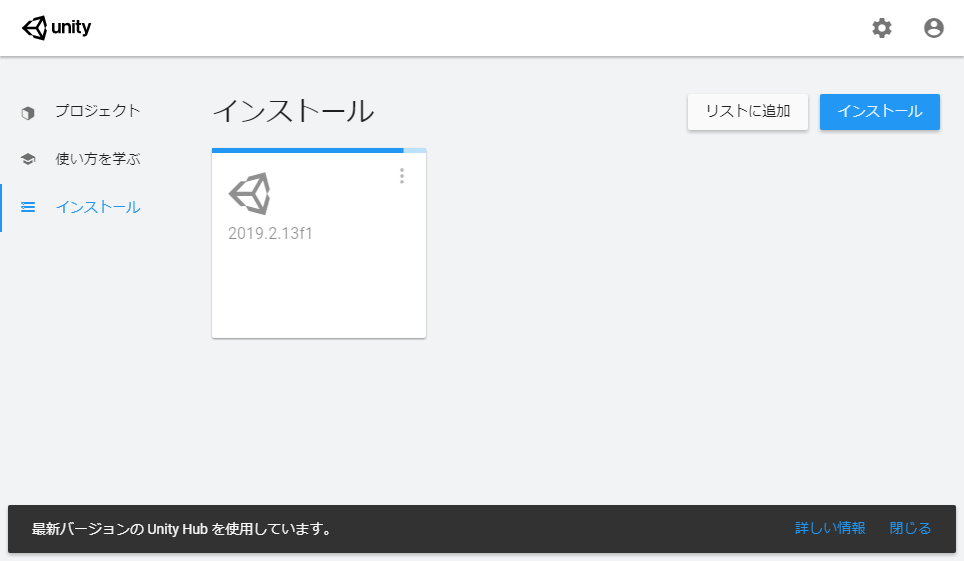

1,Unityをインストールじゃい[Unity Hubとバージョン2019.2.13f1]

2,Live2DのSDK?「CubismSdkForUnity-4-beta.2.unitypackage」を入れた

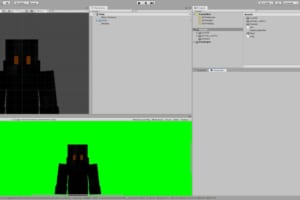

3,フリーのモデルを入手して表示

4,パラメータを動かすとモデルも動くのを確認

5,ちからつきた

きっかけとしては、

Live2Dが自分の動きに合わせて動くの、適当なカメラデバイスとUnityでできるそうじゃないですか

Unityさわってみよう

結局やりたいって思わないと頭に入らないんだなぁ

といったところ

目次

とりあえず書くぞう

参考ページ見てわかるならそれでいいヤツ

備忘録やね

Unityを入れる

公式ページからいただく

ようわからんからとりあえず「Unity Hub をダウンロード」した

Unity Hubを起動したらバージョン指定してUnityをインストール、管理できそうな雰囲気がある

そしてとりあえず最新の「2019.2.13f1」を入れる

プロジェクト作成、テストキャラデータ読み込み

参考サイトの順にやっていくので、ここで説明を書いても二度手間にちがいない(確信

やっていったことをざっくり書いて差違の部分だけちゃんと書く

参考サイトはMacのようだが私はWindowsで始めた

動いてくれよー

・新規プロジェクトの作成

作成時のUnity Versionを最新の2019ホニャララに変えた

・Live2DモデルをUnityに組み込み

ダウンロードページにバージョンの選択肢は無いな?多分

Unity用のSDK「CubismSdkForUnity-4-beta.2.unitypackage」を入手した

しばらくみちなり

・フリーのモデルをダウンロード

・moc3ファイルの書き出しのところで「Live2D Cubism Setup 4.0.02」をインストールして使用

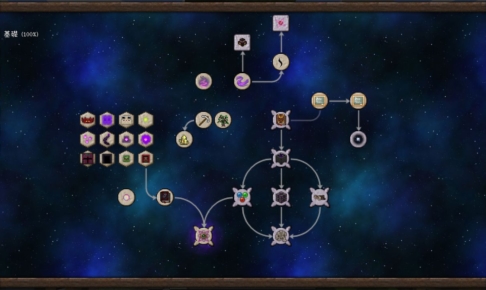

・キャラを画面に出してパラメータを変えるとキャラが動くことを確認

マイクとかで動かす

設定できるとキャラが動いて楽しくなってきた

・口パクの実装

・まばたきを付ける

・呼吸モーション

・頭と視線を動かす

表情を付ける(レイヤーで切り替える)の項目をパス

アニメーションとかレイヤーを追加するとかなんとか?

長そうなので後回し

(断念)「AniLipSync-live2d」でリップシンクを実装

上の口パクは口の開ける大きさだけだが、こちらは口の形にもパターンを付けられるそうだ

参考ページからの参考ページ

全然わからんポイントが発生してダメ

サンプルモデル、マイクに反応するのが髪の毛って、どうしてよ

なんかうまくいかんし、自分が考えているアバターは口が無いので後回し

一旦終わり!

コメントを残す